Quando lavori con i timestamp Unix, la scelta tra secondi vs millisecondi vs microsecondi può influenzare significativamente le prestazioni della tua applicazione, i requisiti di archiviazione e la precisione. Mentre i timestamp Unix misurano tradizionalmente il tempo in secondi dal 1° gennaio 1970, le applicazioni moderne richiedono spesso una precisione maggiore per registrare eventi, misurare i tempi di risposta delle API o sincronizzare sistemi distribuiti. Questa guida analizza le differenze pratiche tra ogni livello di precisione e fornisce criteri chiari per aiutarti a scegliere l'opzione giusta per il tuo caso specifico.

Indice dei Contenuti

Comprendere i Tre Livelli di Precisione

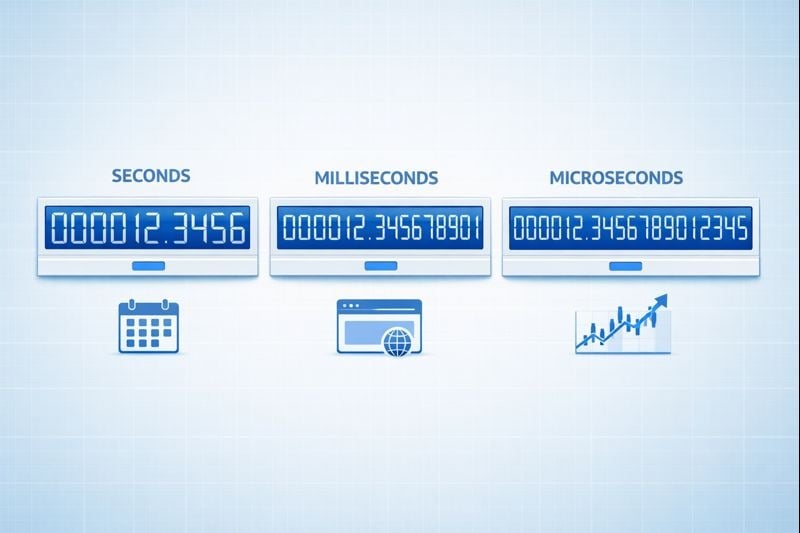

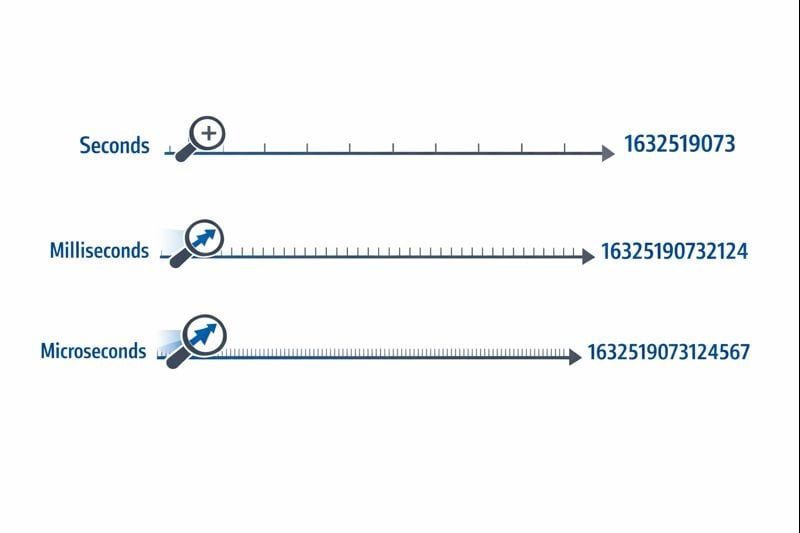

I timestamp Unix rappresentano il tempo come un singolo numero che conta dal punto di riferimento dell'epoch time. Il livello di precisione determina quanto finemente puoi misurare gli intervalli di tempo.

Secondi (10 cifre): Il formato originale del timestamp Unix usa un intero a 32 bit o 64 bit che rappresenta secondi interi. Un valore tipico appare come 1704067200, che rappresenta esattamente un momento nel tempo senza suddivisioni.

Millisecondi (13 cifre): Questo formato moltiplica il valore dei secondi per 1.000, aggiungendo tre cifre decimali di precisione. Lo stesso momento diventa 1704067200000. La funzione Date.now() di JavaScript restituisce timestamp in questo formato per impostazione predefinita.

Microsecondi (16 cifre): Utilizzato principalmente in sistemi che richiedono precisione estrema, questo formato moltiplica i secondi per 1.000.000. Il valore diventa 1704067200000000. Linguaggi come time.time_ns() di Python possono lavorare anche con precisione al nanosecondo (19 cifre), anche se i microsecondi rappresentano il limite superiore pratico per la maggior parte delle applicazioni.

Implicazioni per Archiviazione e Prestazioni

Il livello di precisione che scegli influenza direttamente la dimensione del database, il consumo di memoria e le prestazioni delle query. Questi vincoli diventano critici man mano che la tua applicazione cresce.

Requisiti di Archiviazione

Un intero a 32 bit (4 byte) può memorizzare timestamp a livello di secondo fino a quando non si verifica il problema dell'Anno 2038. La maggior parte dei sistemi moderni usa interi a 64 bit (8 byte) per evitare questa limitazione.

- Secondi: 8 byte per un intero a 64 bit con segno (BIGINT)

- Millisecondi: 8 byte per un intero a 64 bit con segno (BIGINT)

- Microsecondi: 8 byte per un intero a 64 bit con segno (BIGINT)

Mentre ogni livello di precisione usa la stessa archiviazione di 8 byte nei database moderni, l'impatto reale deriva dalle operazioni di indicizzazione e query. I numeri più grandi richiedono più cicli CPU per le operazioni di confronto, e gli alberi B degli indici diventano leggermente meno efficienti con valori chiave più grandi.

Prestazioni delle Query del Database

Quando lavori con timestamp Unix nei database, il livello di precisione influenza le query di intervallo e le operazioni di ordinamento. Un database che confronta numeri a 10 cifre funziona marginalmente più velocemente rispetto al confronto di numeri a 16 cifre, anche se la differenza diventa evidente solo con milioni di righe.

Più criticamente, mescolare livelli di precisione nel tuo database crea overhead di conversione. Se il livello applicativo invia timestamp in millisecondi ma il database memorizza secondi, ogni query richiede una divisione per 1.000, impedendo l'uso efficiente degli indici.

Considerazioni su Rete e API

I payload JSON trasmettono i timestamp come stringhe o numeri. Un timestamp in microsecondi a 16 cifre aggiunge 6 caratteri extra rispetto a un timestamp in secondi a 10 cifre. Su milioni di chiamate API, questo aggiunge costi di larghezza di banda misurabili e overhead di serializzazione.

Quando Usare i Secondi

La precisione a livello di secondo rimane la scelta migliore per la maggior parte delle funzionalità rivolte agli utenti dove la percezione umana definisce la scala temporale rilevante.

Casi d'Uso Ideali

- Post e commenti sui social media: Gli utenti non percepiscono differenze sotto un secondo

- Attività pianificate e cron job: La maggior parte dell'automazione funziona su confini di minuti o ore

- Token di autenticazione utente: La scadenza della sessione non richiede precisione sub-secondo

- Date di pubblicazione contenuti: Articoli, video e post di blog utilizzano precisione al secondo

- Sistemi di prenotazione e riserva: Gli appuntamenti si allineano tipicamente a slot di minuti o ore

Passaggi di Implementazione Pratica

Per implementare efficacemente i timestamp a livello di secondo:

- Usa colonne

BIGINTnel tuo database per memorizzare interi a 64 bit con segno - Crea indici sulle colonne timestamp per query di intervallo come "post delle ultime 24 ore"

- In JavaScript, converti i timestamp in millisecondi:

Math.floor(Date.now() / 1000) - In Python, usa:

int(time.time()) - Documenta la tua scelta di precisione nelle specifiche API così i consumatori sanno se moltiplicare per 1.000

Quando Usare i Millisecondi

La precisione al millisecondo diventa necessaria quando devi tracciare eventi che si verificano più volte per secondo o misurare durate inferiori a un secondo.

Casi d'Uso Ideali

- Monitoraggio tempi di risposta API: Tracciare se gli endpoint rispondono entro 200ms o 800ms

- Transazioni finanziarie: Registrare la sequenza esatta di scambi o passaggi di elaborazione pagamenti

- Messaggistica in tempo reale: Ordinare messaggi chat inviati entro lo stesso secondo

- Analitiche streaming video: Registrare eventi di riproduzione e incidenti di buffering

- Coordinamento sistemi distribuiti: Sincronizzare eventi attraverso più server

Passaggi di Implementazione Pratica

Per implementare timestamp a livello di millisecondo:

- Usa colonne

BIGINTnel tuo database con documentazione chiara che i valori rappresentano millisecondi - In JavaScript, usa

Date.now()direttamente (restituisce millisecondi per impostazione predefinita) - In Python, usa:

int(time.time() * 1000) - Per i timestamp Discord e piattaforme simili, i millisecondi forniscono la precisione standard

- Aggiungi validazione a livello applicativo per assicurarti che i timestamp rientrino in intervalli ragionevoli (non accidentalmente in secondi o microsecondi)

Vincoli del Mondo Reale

La precisione al millisecondo introduce una sfida sottile: non tutti i sistemi generano timestamp al millisecondo veramente accurati. La risoluzione dell'orologio del sistema operativo varia, e gli ambienti virtualizzati potrebbero aggiornare i loro orologi solo ogni 10-15 millisecondi. I tuoi timestamp potrebbero mostrare falsa precisione se l'orologio sottostante non supporta vera accuratezza al millisecondo.

Quando Usare i Microsecondi

La precisione al microsecondo è eccessiva per la maggior parte delle applicazioni ma diventa essenziale in domini specializzati che richiedono accuratezza estrema.

Casi d'Uso Ideali

- Sistemi di trading ad alta frequenza: Registrare aggiornamenti del book ordini che si verificano migliaia di volte per secondo

- Profilazione delle prestazioni e benchmarking: Misurare tempi di esecuzione delle funzioni nell'intervallo dei microsecondi

- Raccolta dati scientifici: Registrare letture di sensori o misurazioni sperimentali

- Analisi pacchetti di rete: Catturare tempistiche esatte di eventi di rete per sicurezza o debug

- Elaborazione audio/video: Sincronizzare flussi multimediali a livello di frame o campione

Passaggi di Implementazione Pratica

Per implementare timestamp a livello di microsecondo:

- Verifica che il tuo linguaggio di programmazione e database supportino la precisione al microsecondo (non tutti lo fanno)

- In Python, usa:

int(time.time() * 1_000_000) - In C/C++, usa

gettimeofday()oclock_gettime()conCLOCK_REALTIME - Considera l'uso di database time-series specializzati come InfluxDB o TimescaleDB progettati per timestamp ad alta precisione

- Documenta chiaramente il requisito di precisione, poiché la maggior parte degli sviluppatori assumerà millisecondi per impostazione predefinita

Vincoli del Mondo Reale

I timestamp al microsecondo creano sfide significative nei sistemi distribuiti. La latenza di rete si misura tipicamente in millisecondi, rendendo la sincronizzazione a livello di microsecondo attraverso server quasi impossibile senza hardware specializzato come orologi sincronizzati GPS. Se la tua applicazione funziona attraverso più data center, la precisione al microsecondo potrebbe fornire falsa accuratezza.

Caso Studio: Sistema di Elaborazione Ordini E-commerce

Caso Studio Ipotetico:

Il seguente esempio dimostra il processo decisionale del mondo reale per la precisione dei timestamp. Mentre l'azienda è fittizia, i vincoli tecnici e le soluzioni rappresentano scenari comuni.

ShopFast, una piattaforma e-commerce di medie dimensioni, inizialmente costruì il loro sistema di elaborazione ordini usando timestamp Unix a livello di secondo. Man mano che scalarono per elaborare 500 ordini al minuto durante le ore di punta, incontrarono un problema critico.

Il Problema

Più ordini piazzati entro lo stesso secondo non potevano essere ordinati in modo affidabile. Quando i clienti contattavano il supporto chiedendo "quale ordine è passato per primo?", il sistema non poteva fornire una risposta definitiva. Più criticamente, il loro sistema di rilevamento frodi doveva segnalare quando la stessa carta di credito veniva usata per più acquisti entro una finestra breve, ma la precisione al secondo rendeva questo inaffidabile.

L'Analisi

Il team di ingegneria valutò i loro requisiti attraverso diversi componenti del sistema:

- Timestamp creazione ordini: Richiedeva precisione al millisecondo per sequenziamento corretto

- Campi last_updated catalogo prodotti: La precisione al secondo rimaneva sufficiente

- Log elaborazione pagamenti: Richiedeva precisione al millisecondo per rilevamento frodi

- Date creazione account clienti: La precisione al secondo rimaneva sufficiente

- Logging richieste API: Richiedeva precisione al millisecondo per monitoraggio prestazioni

La Soluzione

Invece di convertire l'intero database ai millisecondi, implementarono un approccio ibrido:

- Migrarono

orders.created_atda secondi a millisecondi moltiplicando i valori esistenti per 1.000 - Aggiornarono il loro livello API per accettare e restituire timestamp in millisecondi per endpoint relativi agli ordini

- Lasciarono i timestamp rivolti agli utenti (creazione account, ultimo login) in secondi per minimizzare lo scope della migrazione

- Aggiunsero documentazione chiara distinguendo quali campi usavano quale precisione

- Implementarono validazione a livello applicativo per catturare disallineamenti di precisione accidentali

I Risultati

Dopo la migrazione, il sistema poteva sequenziare ordini in modo affidabile e rilevare pattern di frode. L'aumento di archiviazione era trascurabile (aggiungendo tre cifre ai numeri esistenti), ma la funzionalità migliorata giustificava lo sforzo di migrazione. Le prestazioni delle query rimasero virtualmente identiche poiché mantennero l'indicizzazione corretta.

La lezione chiave: non hai bisogno di precisione uniforme attraverso l'intera applicazione. Scegli il livello appropriato per ogni caso d'uso specifico basato sui requisiti reali, non su preoccupazioni teoriche.

Migliori Pratiche per Scegliere la Precisione dei Timestamp

Segui queste linee guida quando implementi timestamp Unix nelle tue applicazioni:

1. Inizia con i Secondi, Aggiorna Solo Quando Necessario

Predefinisci la precisione a livello di secondo a meno che tu non abbia un requisito specifico per granularità più fine. L'ottimizzazione prematura spreca tempo di sviluppo e crea complessità non necessaria. La maggior parte delle applicazioni non ha mai bisogno di precisione sub-secondo.

2. Mantieni Coerenza Entro i Domini

Usa lo stesso livello di precisione per timestamp correlati. Se la tua tabella orders usa millisecondi, le tue tabelle order_items e order_payments dovrebbero corrispondere. Mescolare livelli di precisione forza conversioni costanti e crea bug.

3. Documenta la Tua Scelta di Precisione

Aggiungi commenti nel tuo schema database, documentazione API e codice spiegando se i timestamp rappresentano secondi, millisecondi o microsecondi. Un valore timestamp di 1704067200000 è ambiguo senza contesto.

4. Valida gli Intervalli dei Timestamp

Implementa validazione per catturare errori di precisione. Un timestamp in secondi dovrebbe cadere tra circa 1.000.000.000 (settembre 2001) e 2.000.000.000 (maggio 2033) per date attuali. Un timestamp in millisecondi dovrebbe essere circa 1.000 volte più grande. Catturare questi errori presto previene corruzione dei dati.

5. Considera i Tipi Nativi del Tuo Database

Alcuni database offrono tipi timestamp nativi con precisione incorporata. Il tipo TIMESTAMP di PostgreSQL memorizza precisione al microsecondo internamente. Il tipo DATETIME di MySQL supporta microsecondi dalla versione 5.6.4. Questi tipi nativi spesso forniscono migliore ottimizzazione delle query rispetto a memorizzare interi grezzi.

6. Considera la Deriva dell'Orologio nei Sistemi Distribuiti

Se stai confrontando timestamp generati da server diversi, anche la precisione al millisecondo può essere fuorviante senza sincronizzazione corretta dell'orologio. Implementa NTP (Network Time Protocol) su tutti i server e considera l'uso di orologi logici (come timestamp Lamport o orologi vettoriali) per ordinare eventi nei sistemi distribuiti.

7. Testa Accuratamente la Logica di Conversione

Quando converti tra livelli di precisione, testa casi limite come timestamp negativi (date prima del 1970), timestamp molto grandi (date del futuro lontano) e i confini dei tuoi tipi interi. Un intero a 32 bit non può memorizzare timestamp in millisecondi oltre il 2038.

8. Pianifica per il Problema dell'Anno 2038

Se stai usando timestamp a livello di secondo, assicurati di usare interi a 64 bit, non 32 bit. Il problema dell'Anno 2038 colpisce solo interi con segno a 32 bit. Seguire le migliori pratiche del tutorial sui timestamp Unix aiuta a rendere la tua applicazione a prova di futuro.

Conclusioni

Scegliere tra secondi vs millisecondi vs microsecondi per i timestamp Unix dipende dai requisiti specifici della tua applicazione, non da preferenze tecniche arbitrarie. La precisione a livello di secondo gestisce efficacemente la maggior parte delle funzionalità rivolte agli utenti, la precisione al millisecondo abilita il monitoraggio API e la coordinazione in tempo reale, e la precisione al microsecondo serve applicazioni specializzate ad alta frequenza. Inizia con l'opzione più semplice che soddisfa i tuoi bisogni, mantieni coerenza entro dati correlati e documenta chiaramente le tue scelte. Comprendendo i compromessi pratici tra archiviazione, prestazioni e precisione, puoi prendere decisioni informate che scalano con la crescita della tua applicazione.

Converti Tra Formati Timestamp Istantaneamente

Passa tra secondi, millisecondi e microsecondi con il nostro convertitore timestamp Unix gratuito. Non serve programmazione.

Prova il Nostro Strumento Gratuito →